Что такое модерация контента? Типы модерации и инструменты

Уровень сложности

Средний

Время на прочтение

7 мин

Количество просмотров 466

Цифровой мир находится в состоянии постоянного движения, и одной из его мощных движущих сил является генерируемый контент. Сегодня люди охотнее поверят мнению, высказанному другими людьми онлайн, чем информации, предоставляемой компаниями и государственными органами. В этой статье мы расскажем, что такое модерация контента.

Ежедневно публикуются невообразимые объёмы текста, изображений и видео, поэтому компаниям необходимо отслеживать контент, хранящийся на их платформах. Это критически важно для обеспечения безопасной и надёжной среды для клиентов, а также для мониторинга социальных влияний на восприятие брендов и соответствия государственным требованиям.

Наиболее эффективным способом достижения всех этих целей является модерация контента.

Под модерацией контента понимается отсев недопустимого контента, публикуемого пользователями на платформе. Этот процесс включает в себя применение заранее установленных правил мониторинга контента. Если контент не соответствует требованиям, он помечается и удаляется. Причины этого могут быть разными: насилие, оскорбления, экстремизм, нагота, враждебные высказывания, нарушения авторских прав и тому подобное.

Задача модерации контента — обеспечение безопасности платформы и её соответствия политике компании по обеспечению доверия и защиты. Модерация контента широко применяется в социальных сетях, на веб-сайтах и в приложениях для онлайн-знакомств, на торговых площадках, форумах и других подобных платформах.

Почему модерация контента важна?

Из-за огромного объёма ежесекундно создаваемого контента платформы, основанные на генерируемом пользователями контенте, с трудом справляются с недопустимыми и оскорбительными текстами, изображениями и видео.

Модерация контента — единственный способ поддерживать соответствие веб-сайта стандартам, защищать клиентов и репутацию компании. С её помощью можно обеспечить выполнение предназначения платформы и не становиться площадкой для спама, насилия и нецензурного контента.

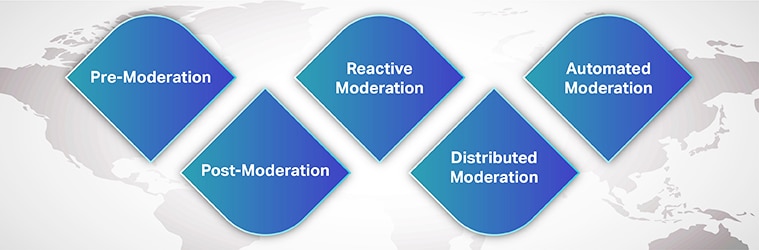

Типы модерации контента

При выборе способа реализации модерации контента на платформе следует учитывать множество факторов, например, задачи бизнеса, типы генерируемого пользователями контента и специфику пользовательской базы.

Вот основные типы процессов модерации контента, которые можно выбрать для своей компании:

1. Автоматическая модерация

Для ускорения и упрощения процесса модерации сегодня активно применяются технологии. Алгоритмы на основе ИИ анализируют текст и графику за крошечную долю того времени, которое бы для этого понадобилось людям; и самое главное — они не страдают от психологических травм, вызванных обработкой недопустимого контента.

При работе с тексом автоматическая модерация может отсеивать ключевые слова, считающиеся проблемными. Более сложные системы могут выявлять спорные паттерны и выполнять анализ взаимосвязей.

Что касается графической информации, то ИИ-инструменты наподобие Imagga позволяют выполнять мониторинг изображений, видео и прямых трансляций. Такие решения выявляют недопустимые изображения и имеют различные опции для управления пороговыми значениями и типами визуального контента.

Хотя модерация на основе технологий становится всё более точной и эффективной, она не способна полностью заменить проверку человеком, особенно в сложных ситуациях. Именно поэтому при автоматической модерации по-прежнему используется сочетание технологий и труда живых модераторов.

2. Премодерация

Это самый сложный способ решения задачи модерации контента. При нём каждый элемент контента проверяется перед публикацией на платформе. Когда пользователь публикует текст или графическую информацию, элемент передаётся в очередь проверки. Его публикуют на платформе только после того, как модератор контента одобрит его.

Хотя это самый надёжный способ блокировки вредного контента, такой процесс довольно неспешен и неприменим в стремительном онлайн-мире. Однако платформы, требующие высокого уровня защиты, по-прежнему используют такой способ модерации. Одним из примеров могут быть платформы для детей, где безопасность пользователей — это самое важное.

3. Постмодерация

Постмодерация — самый типичный способ отсева контента. Пользователи могут публиковать свой контент в любой момент, но все элементы становятся в очередь на модерацию. Если элемент помечен как недопустимый, он удаляется, чтобы защитить остальных пользователей.

Платформы стремятся снизить время проверок, чтобы недопустимый контент не оставался онлайн слишком долго. Хотя постмодерация не так безопасна, как премодерация, сегодня это всё равно предпочтительный способ для многих цифровых бизнесов.

4. Реактивная модерация

При реактивной модерации пользователи отмечают контент, который считают недопустимым или нарушающим правила платформы. В некоторых случаях она может быть эффективным решением.

Для обеспечения оптимальных результатов реактивную модерацию можно использовать и как единственный способ проверки, и в сочетании с постмодерацией. В последнем случае пользователи могут помечать контент после того, как он прошёл процессы модерации, обеспечивая таким образом двойную защиту.

Если вы решите использовать только реактивную модерацию, следует учесть и определённые риски. Саморегуляция платформы кажется отличной идеей, однако может привести к тому, что недопустимый контент будет находиться онлайн слишком долго. Это может нанести долговременный ущерб репутации компании.

5. Распределённая модерация

Этот тип модерации целиком полагается на помощь онлайн-сообщества в проверке контента и его удалении. Пользователи используют систему рейтингов, чтобы указывать, соответствует ли контент требованиям платформы.

Такой способ используется редко, потому что создаёт серьёзные сложности для компаний с точки зрения репутации и соответствия требованиям закона.

Как работает модерация контента?

Чтобы внедрить на своей платформе модерацию контента, сначала нужно установить чёткие инструкции о том, что же является недопустимым контентом. Благодаря этому люди, выполняющие такую работу (модераторы контента) смогут узнавать, что нужно помечать для удаления.

Кроме типов контента, который нужно просматривать, помечать и удалять, нужно также определить пороговые значения для модерации. Под этим понимается уровень чувствительности, которого должны придерживаться модераторы контента при его проверке. Задаваемые пороговые значения зависят от ожиданий пользователей и их состава, а также от типа вашего бизнеса.

Как объяснялось в предыдущем разделе, модерация контента может принимать различные формы. Премодерация, или проверка контента до его публикации, обычно считается слишком медленной для современных объёмов генерируемого пользователями контента. Именно поэтому большинство платформ предпочитает проверять контент после его публикации и немедленного помещения в очередь модерации.

Постмодерацию часто сочетают с автоматической модерацией для обеспечения наилучших и самых быстрых результатов.

Какие типы контента можно модерировать?

Модерацию можно использовать с любыми типами контента, это зависит от сферы интересов вашей платформы: текст, изображения, видео и даже прямые трансляции.

1. Текст

Текстовые публикации используются повсюду и могут сопровождать все типы визуального контента. Именно поэтому модерация текста — одна из прерогатив для всех типов платформ с генерируемым пользователями контентом.

Просто представьте разнообразие непрерывно публикуемых текстов:

- Статьи

- Обсуждения в социальных сетях

- Комментарии

- Вакансии

- Посты на форумах

На самом деле, модерация текста может быть довольно сложной задачей. Выявления оскорбительных ключевых слов часто недостаточно, потому что недопустимый текст может состоять из последовательности абсолютно допустимых слов. Также следует учитывать нюансы и культурную специфику.

2. Изображения

Модерация визуального контента считается чуть более простой, однако критически важно наличие руководств и пороговых значений. Здесь тоже могут играть свою роль культурные тонкости, поэтому важно подробно знать специфику пользовательских баз в различных географических регионах.

Проверка больших объёмов изображений может быть довольно трудной, это важная тема для платформ визуального контента наподобие Pinterest и Instagram. Модераторы контента могут видеть крайне травмирующие изображения, что создаёт огромный риск для их работы.

3. Видео

Сегодня видео стало одним из повсеместных типов контента. Однако его модерация — непростая работа. Весь видеофайл может быть удалён из-за наличия единственной недопустимой сцены.

Ещё одна серьёзная сложность модерации видеоконтента заключается в том, что он часто содержит разные типы текста, например, субтитры и заголовки. Их тоже необходимо проверять, прежде чем одобрить видео.

4. Прямые трансляции

Существует также потоковое вещание в прямом эфире, и это совершенно иной тип контента. Для него не только нужно модерировать видео и текст, это ещё и должно происходить в момент непосредственной трансляции контента.

Работа модератора контента

По сути, задача модератора контента заключается в проверке серий контента (текстового или визуального) и в пометке контента, не соответствующего заранее установленным инструкциям платформы. Это значит, что сотрудник должен вручную просматривать каждую единицу контента, полностью проверять и оценивать её допустимость. Часто это довольно медленный (и опасный) процесс, если модератору не помогает автоматическая предварительная проверка.

Сегодня уже не секрет, что ручная модерация контента сказывается на людях. Такая работа скрывает множество рисков для психического состояния и здоровья модераторов. Они могут сталкиваться с самым неприемлемым, жестоким, оскорбительным и ужасным контентом.

Именно поэтому в последние годы создано множество различных решений для модерации контента, берущих на себя самую сложную часть работы.

Часто задаваемые вопросы

Что такое модерация контента?

Модерация контента — это работа по отсеиванию недопустимого контента, публикуемого пользователями на платформе. Её задача заключается в защите пользователей от любого контента, который может быть небезопасным или недопустимым, что, в свою очередь, способно испортить онлайн-репутацию платформы.

Как работает модерация контента?

Модерацию контента можно выполнять вручную живыми модераторами, которых проинструктировали о типах контента, считающегося неприемлемым, или автоматически, при помощи ИИ-платформ для точной модерации контента. В некоторых случаях для ускорения и улучшения результатов может использоваться сочетание ручной и автоматической модерации контента.

Какие можно привести примеры модерации контента?

Модерация контента необходима, когда контент должен демонстрироваться несовершеннолетним. В таком случае неприятный, насильственный или нецензурный контент должен тщательно проверяться и помечаться как недопустимый. Модерация контента может применяться к тексту, изображениям, видео и прямым трансляциям.

Поскольку Facebook, Twitter и YouTube недавно объявили о наборе кадров в команды по модерации контента (пусть и в разном объеме), я решил немного рассказать о том, как устроена работа таких систем. Большая часть этой статьи основана на моем личном опыте в YouTube, однако подход других компаний к этим вопросам идентичен. Я буду говорить в первую очередь о пользовательском, а не рекламном контенте. Логично, что к рекламе должны применяться немного другие стандарты. То, что я расскажу, применимо к текстам, изображениям и видео/аудио, которые может создать и опубликовать обычный пользователь.

Что нужно понимать под модерацией контента

Модерация, или проверка, контента – это термин, который применяется к контенту (тексту, изображениям, аудио, видео), который загружают, публикуют и распространяют пользователи социальных платформ. Его нужно отличать от рекламных или редакционных материалов (то есть контент, который помогает продвигать товары или сообщать новую информацию, если такая функция существует на платформе), которыми обычно занимаются отдельные команды с собственными стандартами проверки.

Задача большинства платформ модерации контента – претворение в жизнь Стандартов сообщества или Пользовательского соглашения, в которых оговорено, что можно и что нельзя публиковать на платформе. Как легко догадаться, в этой области множество белых, черных и серых областей, поэтому специалисты проходят специальную подготовку, учатся принципам и правилам принятия решений.

На каком этапе в процессе участвуют люди

Было бы очень странно (и неправильно), если бы люди 1) проверяли весь контент, опубликованный на сайте, и 2) проверяли контент до публикации – то есть «одобряли» контент, прежде чем пользователь сможет его опубликовать.

Вместо этого компании широко используют специальные алгоритмы проверки контента, которые берут на себя большую часть тяжелой работы. Алгоритмы пробуют «распознать» контент. На этапе создания можно выделить определенные сигналы – кто загружает контент (история аккаунта или ее отсутствие), геолокация, сам контент и другие метаданные. После публикации контента происходит сбор новых данных – кто его просматривает, жалуются ли на него другие пользователи, делятся ли им и другие параметры.

Эти более информативные сигналы также поступают на вход алгоритма, который уточняет свое решение о том, подходит ли контент сайту. Большинство таких систем позволяют другим пользователям отмечать данные специальными метками, что сильно влияет на решение алгоритма.

В общем случае можно считать, что каждое сообщение в определенный момент времени принимает зеленый, желтый или красный цвет. Зеленый цвет означает, что такое может существовать на сайте. Желтый цвет означает, что алгоритм пока не определился. А красный означает, что этим материалам не место на сайте. Каждая из этих меток непостоянна и неидеальна. Ложные срабатывания и пропуски случаются постоянно.

Недостаточно определять эффективность политики по оценке контента только качеством используемых технологий. На самом деле решения принимаются людьми, но при поддержке программного кода. Менеджмент должен задавать границы между зеленым, желтым и красным цветом. Нужно определить, будут ли новые пользователи по умолчанию считаться доверенными. Нужно задать очередность, с которой объекты из разных категорий будут проходить ручную проверку. И здесь в дело вступают люди…

Что такое очередь на проверку?

Люди помогают создавать обучающие наборы для алгоритмов, однако их главная задача – постоянно заполнять очередь проверки записями, которые выдал алгоритм. Очередь обычно разбивается на несколько потоков в зависимости от приоритетности проверки (например, «срочное», «для проверки в реальном времени» и т.д.) и характеристик проверяющих – люди могут быть обучены проверке разных типов контента, говорить на разных языках и т.д. Это сложная система со встроенной логикой, которая устроена как фабрика.

Объем контента, поступающего в очередь на проверку, определяется общим объемом контента, публикуемого на платформе, и порогами, после которых требуется вмешательство человека. На скорость проверки влияет количество проверяющих, их способности/обучение и эффективность используемых ими инструментов.

Таким образом, если вы слышите, что «объявлен набор десяти тысяч новых модераторов», на это могут быть две причины. Во-первых, может вырасти количество записей на проверку (то есть порог снижается, и вручную будут проверять больше записей). Во-вторых, контент в очереди будет проверяться быстрее (объем контента не изменится, но специалистов станет больше).

Для компаний это вообще важно?

Если честно, да, но…

Да, но обработка контента – это скорее источник затрат, а не прибыли, поэтому часто расходы таких отделов жестко оптимизируют и ограничивают в ресурсах.

Да, но обработка контента часто воспринимается как стартовая работа для будущих менеджеров по продукту, дизайнеров и инженеров, так что эти отделы часто состоят в основном из молодежи и не имеют серьезного влияния на общий ход работы, а каждые один-два года кадровый состав полностью обновляется.

Да, но нехватка разнообразия точек зрения и рассогласование интересов среди старшего руководства часто приводит к тому, что истинный ущерб (для бренда, для пользовательского опыта) в случае появления на платформе «злокачественного» контента часто недооценивается.

Почему явная порнография – самый простой для цензуры тип контента? И почему при этом модерировать контент «сексуальной» направленности очень сложно?

Потому что для публикации порно существуют куда более удобные инструменты, чем Twitter, Facebook или YouTube. Кроме того, алгоритмы с высокой точностью выявляют обнаженные сцены. Однако контент, созданный для сексуального удовлетворения, но не содержащий обнаженные сцены, отслеживать куда сложнее. Писал ли я о политике YouTube касательно фетиш-видео? Интересное было обсуждение…

Что можно посоветовать менеджерам?

- Создайте новую метрику для панели управления. Если гендиректор с командой уделяет показателям безопасности контента столько же внимания, сколько прибыли, вовлечению и другим показателям, это докажет важность модерации контента.

- Используйте абсолютные, а не относительные показатели. Когда самые крупные платформы заявляют, что «99% нашего контента безопасно», на самом деле они имеют в виде «1% от множества – это все еще множество». Стремление преуменьшить масштаб проблем – чаще всего PR-ход – дает понять, что в действительности до этих вещей никому нет дела.

- Сконцентрируйтесь на предотвращении повторных нарушений и быстром исправлении уже имеющихся. Никто не ожидает от этих систем безошибочной работы, и, как мне кажется, лучшая тактика – считать всех пользователей благонадежными, пока те не докажут обратное, а виновных жестко наказывать. Особенно серьезные проблемы с этим у Twitter – в сети тут и там встречаются пользователи из «серой зоны».

- Руководство должно иметь опыт работы в проверке контента. Когда я работал в YouTube на должности ведущего продукт-менеджера, я старался регулярно уделять время проверке контента, так как не хотел отгораживаться от реалий рутинной работы. Конечно, я насмотрелся всякой грязи, зато не забывал, через что приходится проходить нашим специалистам по проверке и пользователям.

- Время проверки можно задавать на законодательном уровне. Мне интересно, может ли государство регулировать время проверки вместо регуляции самого контента. Понятно, что это комплексный вопрос, и новые требования могут привести к тому, что сервисы станут лояльнее подходить к спорному контенту, но сейчас меня очень занимает эта идея.

Источник

Материалы по теме:

Роскомнадзор показал сравнение соцсетей по удалению запрещенного контента

Как эмоции стали ключом к большому бизнесу

Instagram представил спам-фильтр для русского языка и новый фильтр оскорблений

Facebook будет бороться с политической пропагандой в соцсети

Фото на обложке: Carlos Muza/Unsplash

Виды модерации контента

Вы можете выбирать из множества процессы модерации для нужд вашего бренда и согласие пользователя, Некоторые из них:

Предмодерация

Прежде чем контент появится на вашем сайте, он находится в очереди на модерацию. Только после того, как контент будет рассмотрен и признан пригодным для использования, он будет опубликован на платформе. Хотя это безопасный метод блокировки откровенного контента, он требует много времени.

Постмодерация

Постмодерация — это стандартный метод модерации контента, при котором существует компромисс между взаимодействием пользователей и модерацией. Хотя пользователям разрешено публиковать свои материалы, они все еще находятся в очереди на модерацию. Если контент был помечен, он проверяется и удаляется. Компании стремятся сократить время проверки, чтобы нежелательный контент не оставался в сети слишком долго.

Реактивная модерация

При реактивной модерации сообществу пользователей рекомендуется помечать неприемлемый контент, нарушающий правила сообщества. правила и рекомендации. В этом методе внимание сообщества привлекается к контенту, который нуждается в модерации. Однако оскорбительный контент может оставаться на платформе в течение более длительного периода времени.

Распределенная модерация

В методе распределенной модерации онлайн-сообщество может просматривать, помечать и удалять контент, который он считает оскорбительным и противоречащим правилам, используя систему рейтинга.

Автоматическая модерация

Как следует из названия, автоматическая модерация использует различные инструменты и системы для пометки слов или фраз и отклонения отправленных материалов. Он работает путем фильтрации определенных запрещенных слов, изображений и видео с помощью алгоритмов машинного обучения.

Хотя модерация с помощью технологий становится все более распространенной, человеческая умеренность в обзоре нельзя не учитывать. В идеале предприятия используют комбинацию автоматизированных инструментов и модераторов-людей, по крайней мере, в сложных ситуациях.

Как машинное обучение помогает модерировать контент?

С более чем 5 миллиардами человек, использующих Интернет, и более чем 4 миллиардами активных пользователей социальных сетей, нелегко удивиться огромному количеству изображений, текста, видео, постов и сообщений, генерируемых ежедневно. Этот гигантский контент должен быть каким-то образом модерирован, чтобы пользователи, заходящие на их сайты в социальных сетях, могли получить приятный и обогащающий опыт.

Модерация контента возникла как решение для удаления контента, который является явным, оскорбительным, оскорбительным, мошенническим или противоречащим духу бренда. Традиционно предприятия полностью полагались на модераторов-людей для проверки онлайн-контента, созданного пользователями, опубликованного на их платформах. Однако полная зависимость от модераторов-людей может сделать процесс трудоемким, дорогостоящим и неэффективным.

В настоящее время предприятия используют алгоритмы машинного обучения для автоматической и эффективной модерации контента. AI-питание модерация контента сделала весь процесс эффективным, быстрым, последовательным и экономичным.

Хотя этот процесс не устраняет необходимость в модераторах-людях — человек в курсе, участие модераторов-людей помогает решать сложные вопросы. Более того, модераторы-люди лучше понимают языковые нюансы, культурные различия и контекст. Когда используются автоматизированные инструменты с помощью модераторов-людей, это снижает психологическое воздействие воздействия триггерного контента.

Проблемы модерации контента

Еще одна серьезная проблема, связанная с разработкой точного алгоритма модерации контента, — это язык. Надежное приложение для модерации контента должно уметь распознавать несколько языков и понимать культурные нюансы, социальные контексты и языковую динамику.

Так как язык претерпевает несколько изменений с течением времени, так как некоторые слова, которые вчера были безобидными, сегодня могли бы заслужить дурную славу, модель машинного обучения должна идти в ногу с меняющимся миром. Например, изображение обнаженной натуры может быть откровенным и вуайеристским или просто искусством.

Как часть контента воспринимается или считается неуместным, зависит от контекста. И очень важно иметь последовательность и стандарты на вашей платформе, чтобы ваши пользователи могли доверять вашим усилиям по модерации.

Типичный пользователь всегда пытается найти лазейки в ваших рекомендациях и обойти правила модерации. Однако ваш алгоритм машинного обучения должен иметь возможность непрерывно развиваться в соответствии с меняющимся временем.

Наконец, это вопрос предвзятости. Диверсификация вашей базы данных обучения и моделей обучения для определения контекста имеет решающее значение. Хотя разработка надежного алгоритма модерации контента может показаться сложной задачей, она начинается с получения высококачественных обучающих наборов данных.

Сторонние поставщики, обладающие необходимыми знаниями и опытом в предоставлении адекватных наборов данных для обучения, — это то, с чего стоит начать.

Каждый бизнес с социальным присутствием нуждается в передовом решение для модерации контента это помогает завоевать доверие клиентов и обеспечить безупречный клиентский опыт. Чтобы создать приложение и обучить модель машинного обучения, вам необходим доступ к высококачественной базе данных без предвзятости, соответствующей последним тенденциям в области лингвистики и контента на рынке.

Благодаря нашему многолетнему опыту, помогающему предприятиям запускать модели ИИ, Шаип предлагает комплексные системы сбора данных, отвечающие различным потребностям модерации контента.

Content moderation is a critical part of any brand’s social media strategy. In a world of bots, trolls, and scams, social media moderation ensures your brand’s social channels – and their comments sections – are safe, friendly, and pleasant places to be.

What is content moderation?

Content moderation is a part of social media management in which a content moderator handles incoming messages, comments, and other content generated by third parties.

Those third parties might be your followers, customers, or random strangers on the internet. The content moderator’s role is to make sure that real people get a real response, while trolls and bots get sorted to the virtual dustbin.

Content moderators also screen comments and other public-facing content for profanity, obscenity, slurs, and other offensive or material.

Why is content moderation important?

Content moderation is important for a couple of main reasons.

1. Customer service

Customers and potential customers may use your social channels to reach out for help. A content moderator makes sure incoming queries are answered appropriately.

On small teams, the content moderator might be responsible for answering questions directly. On larger teams, they might have help in the form of other marketing members or members of the customer service team.

Source: Hootsuite Social Trends 2023

Either way, the content moderator makes sure incoming DMs and public queries or complaints are handled. That might mean addressing messages themselves or assigning them to someone else.

It’s important to note that the content moderation process is not about trying to make it look like you only get positive comments. Instead, it’s about removing content that violates reasonable standards of decent behavior. Negative comments that are civil should be responded to and addressed, rather than removed.

2. Brand image

Social media content moderation affects brand image in two ways. First, it’s very clear on social media when a brand ignores its customers. Even if someone initially reaches out via DM or other private channels, they’ll soon take their issues public if they don’t get a response.

Staying on top of incoming content is a good way to build social trust.

Unfortunately, there are some nasty people on the internet, and they’re going to post nasty comments on your social accounts. Leaving those unattended can also harm your brand image, as no one wants to see offensive content in the comments of a social post.

You might initially get some sympathy from fans, but if you routinely leave ugly comments unchecked, your brand image will begin to suffer. Since social is an important tool for brand and purchase research, this can have a direct impact on your sales.

This is particularly important if you work with influencers or publish user-generated content.

Why is content moderation important for user-generated campaigns? Because when you’re sharing someone else’s content, it’s even more important to keep the comments civil. Someone who shares their content with your brand once is not likely to do so again if they have to read vitriol, slurs, or profanity in response.

5 content moderation best practices

1. Set up clear guidelines for moderators

Social media moderation is a tough job. A clear set of rules makes the work less stressful for moderators and potentially more effective for the brand.

Just like your social media style guide and social media policy, social media content moderation guidelines outline how to refer to your brand and your products on social channels. In fact, these two documents can be a great starting point when creating your content moderation guidelines.

Your content moderation guidelines also need to explain:

- how moderators should deal with rude and abusive messages and comments

- when to pass messages on to another department

- and when to get more senior staff involved

Incoming comments can also be your first warning of a social media crisis. So make sure your social media moderation guidelines align with and refer to your social media crisis management plan.

2. Answer all real comments and messages

We’ve already talked about why it’s important to answer comments and messages. Here, let’s focus on the “real” part of this best practice.

Content moderation tools help filter out spam comments and messages so you can focus your energy on responding to real people.

It’s important to review your filtered messages regularly to ensure no real messages get missed. Even if people are rude or inappropriate, it’s a best practice to respond. Just make sure you keep things business-like and never stoop to their level.

Of course, some people will never be satisfied with your response and are focused on stirring up trouble. In this case, remember the old saying, “Don’t feed the trolls.” Acknowledge that you have engaged with them to the extent you are able and that you cannot help them any further.

3. Use filters and alerts

There are some words and phrases you know for sure you never want to see in the public comments on your social posts. What those words and phrases are will vary. For example, a skateboard brand might have a broader range of acceptable vocabulary than a pharmaceutical firm.

Fortunately, the social networks offer built-in tools to filter out comments based on your pre-selected list of no-go words.

You can also use these tools to help you manage spam comments. For example, you could block comments that contain the phrase “I’m paying”

Source: Instagram

We walk you through the Instagram process in our post on how to manage Instagram comments. Other platforms offer similar tools. Or you can set up these filters through your dedicated content moderation tool (more on those below).

4. Automate straightforward tasks

Many of the messages that come in, especially to your DMs, will be questions you get over and over again. Fortunately, some of these inquiries can be managed through automated responses.

You can set up ultra-basic autoresponses through the social platforms themselves. But a conversational chatbot like Heyday can actually interact with people who message you. It guides people through their initial contact through to a resolution. This might be a simple answer to their question or even a sale based on customized product recommendations.

Source: Heyday

All of this simplifies human moderation, allowing your content moderators to spend their time on the interactions that bring the most value to your brand.

5. Support your team

Content moderators provide immense value to your organization. It’s important to recognize that they do a difficult job and offer them appropriate support.

Content moderators are on the front lines of the sometimes dark world of online comments. They can see some challenging things and have to deal with even more challenging people. Recognize that your content moderators are not robots. They need time and support to decompress from those difficult interactions.

Make workplace wellness a priority. Check in regularly to see how your moderators are doing, and solicit their input on any ways in which you can make their work less stressful.

4 content moderation tools for businesses of all sizes

1. Hootsuite

Hootsuite can help with your content moderation in a couple of key ways.

Hootsuite Streams

First, Hootsuite Streams are a simple, free content moderation solution for small businesses

Each of the links below takes you to a detailed help article with everything you need to know to set up content moderation for the specified platform.

- Facebook comment moderation. From your Hootsuite streams, you can like or hide comments on your Facebook Page or profile. You can also reply to comments both publicly and privately.

- Instagram comment moderation. If your Instagram business profile is fully authenticated with Facebook, you can hide or delete comments in your My Posts stream. You can also reply to comments as long as your profile is connected to a Facebook Page.

- TikTok comment moderation. WIth Hootsuite streams, you can comment on, reply to, and hide your own comments and comments from others in TikTok My Videos streams. You can also sort comments and delete your own comments.

- YouTube comment moderation. The first step is to enable content moderation for your YouTube channel. Then, you can approve, delete, or reply to comments in your YouTube Moderate and Likely Spam streams in Hootsuite, before they’re published.

- LinkedIn comment moderation. If a particular LinkedIn post is getting a lot of comments, you can create a Hootsuite stream specifically for that post. You can then moderate the comments for that post separately to make sure nothing gets missed.

Hootsuite Inbox

With Hootsuite Inbox, you can fully bridge the gap between social media engagement and customer service — and manage all of your social media messages in one place. This includes:

- Private messages and DMs

- Public messages and posts on your profiles

- Dark and organic comments

- Mentions

- Emoji reactions

… and more.

The all-in-one agent workspace makes it easy to

- Track the history of any individual’s interactions with your brand on social media (across your accounts and platforms), giving your team the context needed to personalize replies

- Add notes to customers’ profiles (Inbox integrates with Salesforce and Microsoft Dynamics)

- Handle messages as a team, with intuitive message queues, task assignments, statuses, and filters

- Track response times and CSAT metrics

Book free demo

Plus, Inbox comes with handy automations:

- Automated message routing

- Auto-responses and saved replies

- Automatically triggered customer satisfaction surveys

- AI-powered chatbot features

2. Respondology

Source: Respondology

Repondology is an automated content moderation tool with a particular focus on eliminating racism, slurs, and other abusive comments. It also helps filter out spam and bots, along with inappropriate comments that are potentially damaging to your brand.

3. BrandFort

Source: BrandFort

BrandFort uses artificial intelligence to filter out hate, spam, profanity, and overtly negative comments on Facebook and Instagram. It offers support for multiple languages.

4. Smart Moderation

Source: Hootsuite App Directory

Smart Moderation is another automation tool that moderates comments on Facebook, Instagram and YouTube. It’s designed to filter out inappropriate content including abusive language, hate speech, spam, trolling, and bots.

Content moderation FAQs

What does a content moderator do?

Content moderators deal with all incoming comments and messages on social media platforms, both public and private.

What are the types of content moderation?

The main types of content moderation are:

- Pre-moderation. This content moderation process is used in blogs or online communities rather than in the more narrow content moderation definition that applies to social media. This is when all comments go into a queue and have to be approved before they are posted.

- Post-moderation. This is the most common kind of content moderation in social media, where your content moderator reviews all comments after they are posted.

- Automated moderation. This type of content moderation refers to blocking a list of specific words or phrases through a more sophisticated content moderation tool.

What skills do you need to be a content moderator?

First off, content moderators require the ability to deal with challenging work. It can be a fun job because it involves interacting with fans and followers of your brand’s social channels. But it also involves dealing with spammers, scammers, angry customers, and other difficult tasks.

Content moderation teams also need to understand how to use social tools effectively. This includes both the social platforms themselves as well as any content moderation tools in use.

Finally, content moderators require good writing and editing skills, so they are able to represent the brand well through their responses to comments and messages on social channels.

Save time managing your social media presence with Hootsuite. From a single dashboard you can publish and schedule posts, find relevant conversions, engage the audience, measure results, and more. Try it free today.

Get Started

Save time with automated responses, smarter workflows, and friendly chatbots — all in the Hootsuite Inbox.

Free Demo

Просмотров 6.6к. Опубликовано 15.06.2022

Обновлено 21.10.2022

Дмитрий Михляев

Product manager в компании Zvonobot с 2021 года. Разработал концепцию продающего чат-бота в компании и вывел данный продукт на прибыль.

Задача модератора – следить за порядком во время онлайн-бесед пользователей, мониторить работу пабликов, сообществ социальных сетей. Таких прав, как у администратора, владельца, у модератора нет, но все равно возможности специалиста намного шире, чем у обычного посетителя.

Содержание

- Что такое модерация простыми словами

- Принципы работы модерации

- Когда стоит проводить модерацию

- Кто такой модератор

- Какие модераторы бывают

- Супермодератор

- Модератор чата

- Модератор портала либо форума

- Проверяющий новостей

- Права и обязанности модератора

- Обязанности модератора

- Права модератора

- KPI у модераторов

- Как происходит процесс обучения модераторов

- К чему должен быть готов модератор

- Карьерный рост модератора

- Модератор как профессия

- Достоинства

- Недостатки

- Виды и способы модерации

- Предмодерация

- Постмодерация

- Автоматическая модерация

- «Общественная» модерация

- Модерация конфликтов

- Особенности модерации разных площадок

- Модерация чатов

- Модерация форума

- Модерация соцсетей

- Модерация новостей

- Модерирование онлайн-мероприятий

- Как выглядит правильная модерация: мифы и ошибки

- Советы тем, кто хочет стать крутым модератором

- Коротко о главном

Что такое модерация простыми словами

Модератор осуществляет проверку контента на соответствие правилам и управляет им. Речь о постах, аудиозаписях, видео, комментариях и другом контенте. У каждого модератора свой перечень прав и обязанностей – они определяются администратором либо владельцем ресурса.

Основные задачи модерации:

- Ограничение доступа к аккаунту либо беседе (бан) для отдельных пользователей за неподобающее поведение.

- Удаление сообщений, не отвечающих тематике, содержащих брань и личные оскорбления в адрес других пользователей, запрещенные ссылки на сторонние ресурсы.

- Удаление фейков, ботов из беседы.

- Добавление нового контента, редактирование старого.

- Стимулирование активности подписчиков, наполнение страниц интересным контентом.

Принципы работы модерации

Модерация – это не только система управления контентом, но и способ организации культурного общения в рамках единого цифрового пространства. Права и обязанности модератора, участников строго регламентируются, должны быть указаны на сайте.

Модерация всегда должна руководствоваться следующими принципами:

- систематический, логичный, последовательный подход;

- прозрачность процесса;

- структурированность всех этапов проверок.

Когда стоит проводить модерацию

Модерацию необходимо проводить на любых типах ресурсов – сайтах, форумах, где общаются пользователи. Можно организовывать сообщества, колонки публикации и без проверки, но это чревато постоянными конфликтами, нарушением правил, размещением запрещенных сведений.

Модератор должен не только следить за порядком, но и поддерживать жизнь ресурса, мониторить обновления контента, внедрять правила общения, доносить их перечень, необходимость соблюдения для пользователей. Поэтому для полноценной работы специалист должен разбираться в теме, иметь навыки разрешения конфликтов и молниеносно реагировать на любые внештатные ситуации.

Кто такой модератор

Модератор – это проверяющий на онлайн-ресурсах, который должен оперативно убирать весь контент, не отвечающий правилам и поддерживать с участниками обратную связь.

Модерация предполагает соблюдение ответственным лицом всех своих обязанностей. Проверяющий должен знать правила и строго им следовать, подавать собственным поведением пример, устранять конфликты, всегда сохранять нейтралитет. Общение должно быть вежливым.

Для успешной реализации текущих задач специалист должен понимать тематику, специфику ресурса, правила его работы и проверки публикаций. Знание истории портала, местечкового сленга также будет плюсом. Поэтому часто модераторами назначают старожилов ресурса, ранее продемонстрировавших себя с позитивной стороны.

Но только пользовательского опыта проверяющему мало – он регулярно выступает в качества арбитра во время конфликтов и других спорных ситуаций. Для этого нужны развитые коммуникативные навыки, умение поддерживать порядок и не настраивать аудиторию ресурса против администрации, исключать риски повышенного оттока пользователей. Обязанности и права модератора существенно различаются с учетом политики работы владельцев сайта.

Если у пользователей появляются претензии к работе проверяющего, они могут отправить жалобу администрации ресурса. Для этого на каждом сайте предусматриваются специальные формы и разделы.

Какие модераторы бывают

Основные категории проверяющих:

Супермодератор

Главный ответственный специалист. Его права максимальные, часть касается администрирования. Супермодератор следит за проектом в целом, может изменять темы, категории, внедрять новые настройки (публичность, контакты), просматривать статистику группы, блокировать старых участников и принимать новых.

Модератор чата

Мониторит переписки, работу чата. Его роль выполняет пользователь чата, которого наделили обязанностями курировать подконтрольный чат, отслеживать порядок в нем. Основная цель – исключать тех, кто не соблюдает прописанные правила общения. В некоторых чатах действует контроль за IP-адресами пользователей, что предотвращает повторные регистрации.

Модератор портала либо форума

Помогает админу мониторить не отдельные чаты, а целый ресурс – все темы, опросы, комментарии и т. д. Модератор форума либо портала делает проверки на мультиаккаунты, удаляет спам. Поэтому и полномочий у него больше, чем у обычного проверяющего.

Проверяющий новостей

Специалист работает с новостными ресурсами. Нужны определенный опыт, уровень подготовки и обязательно – навыки фактчекинга. Модератор должен понимать принципы новостного формата и проверять все публикации на предмет соответствия требованиям.

Права и обязанности модератора

Модератор обязан постоянно мониторить активность пользователей на ресурсе, проверять контент, комментарии на предмет вероятных нарушений требований конкретной площадки. В зоне основного внимания – взаимные оскорбления, флуд, запрещенный контент, спам, несогласованная реклама.

В отличие от администратора, права модератора небезграничные. Ему могут предоставить расширенные права или полностью их лишить — например, в результате нарушения правил работы или недостаточно качественного выполнения рабочих обязанностей.

Обязанности модератора

- мониторинг комментариев, публикаций;

- проверка сообщений на соответствие правилам;

- общие оповещения с призывом к соблюдению правил;

- ответы на жалобы;

- решение конфликтов.

Карательные меры – основные, но не все функции модератора. Специалист может оповещать о добавлении, изменении правил, новых событий на площадке, решать задачи контент-менеджера (полностью, частично).

Права модератора

- удаление чужих сообщений;

- редактирование, обрезка, скрывание части чужих сообщений;

- удаление страничек пользователей;

- ограничение конкретных пользователей в правах просмотра, редактирования сайта;

- выдача блокировок (временных или перманентных).

KPI у модераторов

Как правило, KPI у модераторов включают:

- Число и качество комментариев за один месяц.

- Скорость реагирования.

- Своевременная реакция на запросы клиента в чатах.

Как происходит процесс обучения модераторов

Обучение не занимает много времени, обычно проводится компаниями бесплатно. Для работы модератором важны такие качества как усидчивость, стрессоустойчивость, умение общаться с разными людьми и решать конфликты. Высокие уровень владения ПК будет плюсом. Безупречная грамотность очень желательна, поскольку пишущий с кучей ошибок модератор формирует соответствующую репутацию ресурса.

В целом, профессия подойдет каждому, у кого есть свободное время и доступ к ПК. Инструкции предоставит администратор ресурса.

Обучиться на модератора в высших учебных заведениях пока нет возможности — не существует учебных программ, а получить необходимые знания и навыки можно и на рабочем месте. Тем не менее, получение высшего образования по социологическим, психологическим направлениям — например, конфликтологии — поможет сформировать нужную базу и повысит качество работы.

К чему должен быть готов модератор

Для успешной работы проверяющий онлайн-ресурса должен учитывать особенности проекта – выучить наизусть термины, сленг клиента, названия отделов, услуг, продуктов, разобраться в должностях сотрудников.

Модератор постоянно решает огромное количество рутинных ежедневных задач. Ему приходится тратить много времени на мониторинг по сути одного и того же, поэтому работу сложно назвать креативной. Нужен определенный склад ума, умение концентрировать внимание на мелочах.

Плюсом будут профессиональные навыки коммуникации с людьми, знание различных психотипов. Чтобы отрабатывать разные виды негатива, нужно осознавать мотивацию конкретного комментатора. Формат общения тоже может различаться – кому-то хватит ответа в шуточной форме, а кто-то ждет реального решения проблемы либо развернутых пояснений.

Модераторам постоянно приходится пропускать через себя негатив, поэтому им требуются высокая стрессоустойчивость и умение не накапливать в себе неприятные эмоции. Не принимайте чужие негативные эмоции на свой счет.

Желательно наличие креативного мышления. Оно поможет вам находить оптимальные выходы из запутанных, сложных ситуаций.

Модератор должен постоянно находиться на связи. Если он спокойно относится к ненормированному графику работы, то сможет зарабатывать больше. То есть специалист может работать по четкому графику и получать фиксированный оклад либо выбирать ненормированный рабочий день и получать различные бонусы.

Ответственность проверяющего перед клиентом максимальная. Неквалифицированный специалист способен испортить имидж компании.

Карьерный рост модератора

Модератор может начать с низов вроде модерации чатов и со временем дорасти до администратора ресурса или супермодератора, руководящего целой командой. Многие специалисты уходят с головой в контент и занимаются только им – причем делать это можно по одному конкретному направлению или сразу по нескольким.

Модератор может пойти дальше и стать проджект-менеджером — специалистом, который руководит проектом в рамках продукта или ресурса. То есть набирает команду, собирает данные, формирует ТЗ, раздает задачи и проверяет их выполнение.

Модератор как профессия

Выше мы писали, что модераторами форумов, чатов обычно становятся старожилы площадок, отлично знающие специфику работы конкретного ресурса. В основном модераторы работают на энтузиазме либо за поощрения от владельцев, администраторов. Крупные площадки предлагают вакансии с достойной оплатой труда.

Профессия в будущем будет становиться все более востребованной – цифровые ресурсы становятся все более важной частью бизнеса и повседневной жизни. Частично из-за этого повышаются и требования к проверке контента, поэтому хорошие модераторы будут нужны всегда.

У профессии есть свои плюсы и минусы, рассмотрим их подробнее.

Достоинства

- Востребованность. Модераторы нужны в интернет-магазинах, группах ВКонтакте, чатах Телеграм и на других ресурсах.

- Постоянное развитие навыков коммуникации. А они пригодятся по жизни в целом.

- Перспективность. Есть возможности для карьерного роста и повышения уровня дохода.

- Простое обучение. Для входа в профессию не нужно специальное образование.

- Гибкий график. Вы можете выбрать удобный для себя формат работы — 5/2, 2/2 или любой другой.

- Возможность удаленной работы. Вы можете не привязываться к стулу в конкретном офисе, работать модератором можно и из дома.

Недостатки

- Рутина. Творческих задач в профессии мало.

- Низкая зарплата на старте. Как и во многих профессиях, новички много не зарабатывают – пока не наработают достаточный опыт.

- Высокие требования к языковой грамотности. Комментарии и сообщения с ошибками, составленные модератором, выглядят непрофессионально.

- Ненормированный график. Чтобы нормально зарабатывать, придется работать сверхурочно.

- Устойчивость к стрессам. Постоянные конфликтные ситуации, во-первых, выводят из равновесия, во-вторых, формируют рабочие условия, которые подходят не всем.

Виды и способы модерации

Существует несколько способов модерации ресурса. Их можно использовать по отдельности либо комбинировать.

Предмодерация

Самый безопасный вариант. Сообщения размещаются только после проверки. Хорошее решение для тех сайтов, которые не приемлют даже непродолжительное засвечивание контента, который не соответствует требованиям.

Минус премодерации – отсутствие оперативности. Одно дело, когда до публикации проверяют статьи, а другое – комментарии и посты. Иногда премодерация применяется выборочно – к новым пользователям, в отдельных тематических категориях.

Постмодерация

В данном случае проверка проводится уже после размещения. Основные плюсы – 100% оперативность и довольные пользователи. Но есть недостатки – модераторы не сразу замечают отдельные нарушения и комментарии, что чревато негативными последствиями. Компромиссный вариант – автоматическая модерация.

Автоматическая модерация

Способ чаще всего задействуют в роли дополнительного. Программный встроенный модуль автоматом фильтрует все публикации, которые явно нарушают правила.

Допустим, есть простые стоп-листы – в них прямо перечисляются запрещенные слова со словоформами. Встречаются более сложные алгоритмы – они анализируют тексты с учетом семантических моделей, определяют тон сообщений, а не только наличие запрещенных терминов. Автоматически можно проверять и тексты, и графику.

«Общественная» модерация

Отдельные функции могут брать на себя пользователи ресурса – например, через систему оценок. Каждый комментарий плюсуют либо минусуют. На Хабре коммент, набравший большое число минусов, постепенно бледнеет и сливается с фоном.

Модерация конфликтов

Модераторы работают не только с контентом, но и с прямыми обращениями от пользователей. Когда кто-то из посетителей жмет кнопку «Пожаловаться», проверяющий получает сообщение и должен урегулировать конфликт. Модератор должен разобраться в ситуации и вынести решение, которое уладит конфликт до его усугубления.

КСТАТИ

Зарегистрируйтесь в нашем сервисе голосовых рассылок Zvonobot и получите первые 20 звонков — бесплатно!

Особенности модерации разных площадок

Существуют различные категории площадок для общения, публикации материалов. Это социальные сети, форумы, чаты, информационные и новостные ресурсы. Общие моменты в работе модератора схожие, но отличия тоже встречаются.

Модерация чатов

Самый сложный в плане мониторинга тип ресурсов. Чаты предполагают быстрое общение в режиме реального времени и почти полностью исключают возможность премодерации. Открытые чаты – раздолье для троллей, спамеров и просто неадекватных пользователей. Поэтому модератору нужно внимательно следить за публикациями и реагировать оперативно – удалять сообщения, нарушающие правила, выносить предупреждения, давать временные или перманентные блокировки, предотвращать повторную регистрацию регулярных нарушителей.

Модерация форума

Форум является более спокойной средой для общения. Работа модератора вдумчивая, не особо динамичная. Нужно мониторить новые темы, комментарии, определять, отвечает публикация тематике раздела или нет, переносить темы в другие ветки, если они не отвечают тематике, удалять оверквотинги (избыточное цитирование предыдущих постов), запрещенный контент, рекламу без разрешения администрации. Если для регистрации пользователи предоставляют персональные данные, модератор видит их, но использовать в своих целях не имеет права. Поэтому работодатель заинтересован в найме добросовестных специалистов.

Модерация соцсетей

У социальных сетей много общего с информационными ресурсами и форумами. Нужно отслеживать активность комментирующих, отклонять или одобрять предлагаемые к публикации материалы. Также модератор может отклонять либо принимать запросы на вступление в закрытые паблики, отслеживать неактивные аккаунты, боты, осуществлять сбор статистики.

Модерация новостей

Новостные сайты – разновидность информационных ресурсов, но есть отличия по формату по требованиям к публикациям.

Здесь модератору требуются опыт и определенная подготовка, понимание новостного формата. Он будет рассматривать новости, предлагаемые сотрудниками редакции или пользователями, проверять их на предмет соответствия новостном формату, делать фактчекинг (глубинный либо беглый), сверку материала с источником и решать, осуществлять публикацию или нет – то есть выступать в качестве выпускающего редактора.

Модерирование онлайн-мероприятий

Наиболее сложное направление – мероприятия, проводимые в прямом эфире. Специалисту нужно иметь хорошие организационные, коммуникативные навыки. Также он выполняет роль ведущего во время встречи, во многом определяет качество фидбека (обратной связи), впечатления участников.

Задачи модератора, работающего на онлайн-мероприятиях:

- Контролировать соблюдение поставленных планов для решения текущих задач;

- Обеспечивать условия для конструктивного, системного общения участников.

- Убедиться в том, что мероприятие проходит согласно правилам, а общение отличается логичностью и последовательностью.

Как выглядит правильная модерация: мифы и ошибки

Что важно помнить, чтобы модерация стала эффективным инструментом:

- Игнорировать необходимость качественной модерации недопустимо, хотя некоторые владельцы ресурсов и профильные агентства так и делают. Если нет контроля за контентом и общением, страдает репутация ресурса.

- Модерацию должен выполнять ответственный за решение конкретных задач специалист. В противном случае работы будут выполняться как попало.

- Только будни и вечером домой – график для офисного работника, но не для модератора. Основная активность в чатах, форумах, социальных сетях приходится на вечер пятницы и выходные. Поэтому ситуацию нужно мониторить постоянно.

Советы тем, кто хочет стать крутым модератором

- Ведите себя, как реальный человек, а не бот. Это располагает.

- Не давайте шаблонные ответы – персонализация срабатывает лучше.

- Помните, что модерация – системная деятельность, и специалисту придется собирать статистику, подготавливать отчеты.

- Переработки – скорее, норма, чем исключение. Но хороший работодатель выплачивает бонусы.

- Работа модератора сложная, стрессовая, но востребованная и очень нужная. Она может быть хобби для старожилов ресурса или стать настоящей профессией с доступными для карьерного роста возможностями.

Коротко о главном

Профессиональная модерация нужна любому ресурсу, на котором общаются посетители и подписчики, публикуются пользовательские материалы. Она может проводиться до и после публикации, выполняться самими пользователями, предполагать задействование автоматизированного софта.

Каждый тип ресурсов предъявляет свои требования к работе проверяющего. Модератор – отдельная профессия, и масштабные ресурсы предлагают интересные вакансии с солидной оплатой труда. При желании работать модератором может простой пользователь – если он имеет адекватную репутацию на сайте и разбирается в тематике.